Нервная сеть: различия между версиями

| [отпатрулированная версия] | [отпатрулированная версия] |

Mvk608 (обсуждение | вклад) |

Mvk608 (обсуждение | вклад) |

||

| Строка 24: | Строка 24: | ||

Британский физиолог [[Шеррингтон, Чарльз Скотт|Ч.Шеррингтон]] в 1898 провел эксперименты для проверки теории Джеймса.<ref>{{cite journal|last=Sherrington|first=C.S.|title=Experiments in Examination of the Peripheral Distribution of the Fibers of the Posterior Roots of Some Spinal Nerves|journal=Proceedings of the Royal Society of London|volume=190|pages=45–186}}</ref> Он пропускал электрический ток вдоль [[Спинной мозг|спинного мозга]] крыс. При этом вместо ожидаемого усиления тока, согласно теорри Джеймса, Шеррингтон обнаружил, что электрический ток ослабевает с течением времени. Результаты экспериментов Шеррингтона сыграли важную роль в разработке теории [[Привыкание (психология)|привыкания]]. |

Британский физиолог [[Шеррингтон, Чарльз Скотт|Ч.Шеррингтон]] в 1898 провел эксперименты для проверки теории Джеймса.<ref>{{cite journal|last=Sherrington|first=C.S.|title=Experiments in Examination of the Peripheral Distribution of the Fibers of the Posterior Roots of Some Spinal Nerves|journal=Proceedings of the Royal Society of London|volume=190|pages=45–186}}</ref> Он пропускал электрический ток вдоль [[Спинной мозг|спинного мозга]] крыс. При этом вместо ожидаемого усиления тока, согласно теорри Джеймса, Шеррингтон обнаружил, что электрический ток ослабевает с течением времени. Результаты экспериментов Шеррингтона сыграли важную роль в разработке теории [[Привыкание (психология)|привыкания]]. |

||

В 1943 |

В 1943 Мак-Каллок и Питтс разработали компьютерную модель нейронной сети<ref>{{cite journal|last=McCullock|first=Warren|coauthors=Walter Pitts|title=A Logical Calculus of Ideas Immanent in Nervous Activity|journal=Bulletin of Mathematical Biophysics|year=1943|volume=5|pages=115–133|doi=10.1007/BF02478259|issue=4}}</ref> на основе математических алгоритмов. Они назвали эту модель «пороговой логикой». Модель Мак-Каллока-Питтса заложила основы двух различных подходов исследований нейронных сетей. Один подход был ориентирован на изучение биологических процессов в головном мозге, другой — на применение нейронных сетей для искусственного интеллекта. |

||

В конце 1940-х |

В конце 1940-х канадский физиолог и психолог [[Хебб, Дональд|Дональд Хебб]] [7] выдвинул гипотезу интерпретациии обучения на основе механизма нейронной пластичности, известную как [[:en:Hebbian theory|теорию Хебба]]. Теория Хебба считается типичным случаем [[Обучение без учителя|самообучения]], при котором испытуемая система спонтанно обучается выполнять поставленную задачу, без вмешательства со стороны экспериментатора. В более поздних вариантах теория Хебба легла в основу описания явления [[Долговременная потенциация|долговременной потенциации]]. Эти идеи с 1948 начали применяться для вычислительных моделей в [[:en:Unorganized machine|B-машинах]] [[Тьюринг, Алан|А.Тьюринга]]. |

||

Фарли и Кларк в 1954 с использованием компьютеров разработали имитацию сети Хебба в [[Массачусетский технологический институт|Массачусетском технологическом институте]].<ref>{{cite journal|last=Farley|first=B|coauthors=W.A. Clark|title=Simulation of Self-Organizing Systems by Digital Computer|journal=IRE Transactions on Information Theory|year=1954|volume=4|pages=76–84|doi=10.1109/TIT.1954.1057468|issue=4}}</ref> Другие исследования нейронных сетей спомощью компьютерного моделирования были проведены в 1956 Рочестером, Холландом, Хебитом и Дуда.<ref>{{cite journal|last=Rochester|first=N.|coauthors=J.H. Holland, L.H. Habit, and W.L. Duda|title=Tests on a cell assembly theory of the action of the brain, using a large digital computer|journal=IRE Transactions on Information Theory|year=1956|volume=2|pages=80–93|doi=10.1109/TIT.1956.1056810|issue=3}}</ref> |

|||

Фарли и Кларк [8] (1954) впервые использовал вычислительные машины, которая тогда называлась калькуляторы, чтобы имитировать Хебба сети в Массачусетском технологическом институте. Другие нейронной сети вычислительных машин были созданы Рочестер, Голландии, привычки, и Дуда [9] (1956). |

|||

Розенблатт [10] (1958) создал |

Розенблатт [10] (1958) создал [[перцептрон]], алгоритм распознавания образов на основе двухслойной обучения компьютера сети с помощью простого сложения и вычитания. С математической нотации, Розенблатт также описаны схемы не в основной персептрон, такие как исключительное или цепи, цепи, математическое вычисление не может быть обработан только после обратного распространения алгоритма была создана Werbos [11] (1975). |

||

Персептрон является по существу линейный классификатор для классификации данных, указанных параметров и выходной функции. Его параметры адаптированы с специальных правил похож на стохастический градиентный спуск крутой. Поскольку внутренний продукт представляет собой линейный оператор в исходном пространстве, персептрон может только совершенно классифицировать набор данных, для которых различные классы линейно отделимы в исходном пространстве, а это часто не полностью для неразборных данных. Хотя разработка алгоритма первоначально составил около энтузиазма, отчасти из-за ее очевидной связи с биологическими механизмами, позднее открытие этого несоответствия вызваны такие модели следует отказаться до введения нелинейных моделей в этой области. |

Персептрон является по существу линейный классификатор для классификации данных, указанных параметров и выходной функции. Его параметры адаптированы с специальных правил похож на стохастический градиентный спуск крутой. Поскольку внутренний продукт представляет собой линейный оператор в исходном пространстве, персептрон может только совершенно классифицировать набор данных, для которых различные классы линейно отделимы в исходном пространстве, а это часто не полностью для неразборных данных. Хотя разработка алгоритма первоначально составил около энтузиазма, отчасти из-за ее очевидной связи с биологическими механизмами, позднее открытие этого несоответствия вызваны такие модели следует отказаться до введения нелинейных моделей в этой области. |

||

Версия от 11:45, 14 мая 2012

Нейронная сеть — термин, имеющий два значения:

1.Биологическая нейронная сеть — сеть, состоящая из биологических нейронов, которые связаны или функционально объединены в нервной системе. В нейронауках зачастую определяется как группа нейронов, которые выполняют специфические физиологические функции. 2.Искусственная нейронная сеть — сеть, состояшая из искусственных нейронов (программируемая конструкция, имитирующая свойства биологических нейронов). Искусственные нейронные сети используются для изучения свойств биологических нейронных сетей, а также для решения задач в сфере искусственного интеллекта.

В данной статье рассматриваются отношения между двумя этими понятиями, подробное описание каждого из них дано в отдельных статьях — биологическая нейронная сеть и искусственная нейронная сеть.

Общий обзор

Биологическая нейронная сеть состоит из группы или групп химически или функционально связанных нейронов. Один нейрон может быть связан со многими другими нейронами, а общее количество нейронов и связей в сети может быть достаточно большим. Место контакта нейронов называется синапсом, типичный синапс — аксо-дендритический химический. Передача импульсов осуществляется химическим путём с помощью медиаторов или электрическим путём посредством прохождения ионов из одной клетки в другую.

Исследования в сфере искусственного интеллекта и когнитивного моделирования пытаются имитировать некоторые свойства биологических нейронных сетей. В сфере искусственного интеллекта искусственные нейронные сети были успешно применены для распознавания речи, анализа изображений и адаптивного управления в целях разработки программных агентов (например, в компьютерных и видеоиграх) или автономных роботов. Большинство искусственных нейронных сетей, используемых в настоящее время сфере искусственного интеллекта, разработаны на основе статистических методов, теории оптимизации и теории управления.

В сфере когнитивного моделирования ведётся физическое или математическое моделирование поведения нейронных систем, начиная с уровня отдельных нейронов (например, моделирование реакции нейрона на стимул), с выходом на уровень нейронных кластеров (например, моделирование выхода дофамина в базальных ганглиях) и организма в целом (например, моделирование ответа организма на раздражители).

История исследований нейронных сетей

Основы теории нейронных сетей были независимо разработаны А.Бэйном[1] (1873) и У.Джеймсом[2] (1890). В своих работах они рассматривают мыслительную деятельность как результат взаимодействия между нейронами в головном мозге.

Согласно Бэйну[1], любая деятельность ведёт к активизации определенного набора нейронов. При повторении той же деятельности связи между этими нейронами укрепляются. Согласно его теории, это повторения ведут к формированию памяти. Научное сообщество того времени восприняло теорию Бэйна скептически, поскольку следствием её являлось возникновение чрезмерного количества нейронных связей в мозге. Теперь очевидно, что мозг является чрезвычайно сложной конструкцией и способен работать с несколькими задачами одновременно.

Теория Джеймса была схожа с теорией Бэйна[2], но в то же время Джеймс предположил, что формирование памяти происходит в результате прохождения электрических токов между нейронами в головном мозге, не требуя соединений нейронов для каждого акта запоминания или действия.

Британский физиолог Ч.Шеррингтон в 1898 провел эксперименты для проверки теории Джеймса.[3] Он пропускал электрический ток вдоль спинного мозга крыс. При этом вместо ожидаемого усиления тока, согласно теорри Джеймса, Шеррингтон обнаружил, что электрический ток ослабевает с течением времени. Результаты экспериментов Шеррингтона сыграли важную роль в разработке теории привыкания.

В 1943 Мак-Каллок и Питтс разработали компьютерную модель нейронной сети[4] на основе математических алгоритмов. Они назвали эту модель «пороговой логикой». Модель Мак-Каллока-Питтса заложила основы двух различных подходов исследований нейронных сетей. Один подход был ориентирован на изучение биологических процессов в головном мозге, другой — на применение нейронных сетей для искусственного интеллекта.

В конце 1940-х канадский физиолог и психолог Дональд Хебб [7] выдвинул гипотезу интерпретациии обучения на основе механизма нейронной пластичности, известную как теорию Хебба. Теория Хебба считается типичным случаем самообучения, при котором испытуемая система спонтанно обучается выполнять поставленную задачу, без вмешательства со стороны экспериментатора. В более поздних вариантах теория Хебба легла в основу описания явления долговременной потенциации. Эти идеи с 1948 начали применяться для вычислительных моделей в B-машинах А.Тьюринга.

Фарли и Кларк в 1954 с использованием компьютеров разработали имитацию сети Хебба в Массачусетском технологическом институте.[5] Другие исследования нейронных сетей спомощью компьютерного моделирования были проведены в 1956 Рочестером, Холландом, Хебитом и Дуда.[6]

Розенблатт [10] (1958) создал перцептрон, алгоритм распознавания образов на основе двухслойной обучения компьютера сети с помощью простого сложения и вычитания. С математической нотации, Розенблатт также описаны схемы не в основной персептрон, такие как исключительное или цепи, цепи, математическое вычисление не может быть обработан только после обратного распространения алгоритма была создана Werbos [11] (1975).

Персептрон является по существу линейный классификатор для классификации данных, указанных параметров и выходной функции. Его параметры адаптированы с специальных правил похож на стохастический градиентный спуск крутой. Поскольку внутренний продукт представляет собой линейный оператор в исходном пространстве, персептрон может только совершенно классифицировать набор данных, для которых различные классы линейно отделимы в исходном пространстве, а это часто не полностью для неразборных данных. Хотя разработка алгоритма первоначально составил около энтузиазма, отчасти из-за ее очевидной связи с биологическими механизмами, позднее открытие этого несоответствия вызваны такие модели следует отказаться до введения нелинейных моделей в этой области.

Нейронные сети научно-исследовательских стагнации после публикации машинного обучения, исследования и Минский Пейперт [12] (1969). Они обнаружили две основные проблемы, связанные с вычислительными машинами, которые обрабатываются нейронной сети. Первый вопрос в том, что однослойные нейронные сети были в состоянии обрабатывать исключительные или цепи. Вторым важным вопросом было то, что компьютеры не были достаточно сложные, чтобы эффективно обрабатывать долго перспективе требует больших нейронных сетей. Нейронные сети научно-исследовательских замедлился до компьютеров достигнут большой вычислительной мощности. Кроме того, ключевым в более поздние достижения были backpropogation алгоритм, который эффективно решена исключительно или задаче (Werbos 1975) [11].

Cognitron (1975) разработан Кунихико Фукусима [13] был одним из первых многослойные нейронные сети с алгоритмом обучения. Фактическая структура сети и методы, используемые для установки соединения весов переходить от одной нейронной стратегии к другой, каждая из которых имеет свои преимущества и недостатки. Сети могут распространять информацию только в одном направлении, или они могут туда и обратно до самодеятельности в узле происходит и сеть располагается на конечное состояние. Возможность для двунаправленного потока входов между нейронами / узлы было произведено с сетью Хопфилда (1982), и специализация этих узлов слоев для конкретных целей был введен в первые гибридные сети.

Параллельно распределенной обработки середине 1980-х стали популярны под названием коннекционизма. Текст Rummelhart и МакКлелланда [14] (1986), при условии полной экспозиции по использованию коннекционизма в компьютерах для имитации нейронных процессов.

Повторное открытие алгоритм обратного распространения, вероятно, основной причиной repopularisation нейронных сетей после публикации «Изучение внутреннего представления от распространения ошибки» в 1986 году (хотя обратное распространение сама датируется 1969 г.). Оригинальный сети использовать несколько слоев вес суммы единиц типа, где было сигмовидной функции или логистической функции, такие как используемые в логистической регрессии. Обучение было сделано форме стохастического градиентного спуска. Занятости цепи правила дифференцирования в получении соответствующего параметра обновления результатов в алгоритм, который, кажется, "backpropagate ошибки, следовательно, номенклатуры. Однако это, по сути формой градиентного спуска. Определение оптимальных параметров в модели такого типа не является тривиальной и местных численные методы оптимизации, такие как градиентный спуск может быть чувствительным к инициализации из-за наличия локальных минимумов обучение критерий. В последнее время сети с той же архитектуре, обратного распространения сети называют многослойный персептрон. Это имя не накладывает никаких ограничений на тип алгоритма, используемого для обучения.

Обратного распространения сетей вызвало большой энтузиазм в то время и было много споров о том, такое обучение может быть реализована в мозг или нет, отчасти потому, что механизм обратной сигнализации не было очевидным в то время, но самое главное, потому что не было вероятным источником для «обучения» или «целевой» сигнал. Тем не менее, с 2006 года, несколько неконтролируемых обучения процедур были предложены нейронные сети с одним или несколькими слоями с помощью так называемого глубокого изучения алгоритмов. Эти алгоритмы могут быть использованы, чтобы узнать промежуточные представления, с или без выходного сигнала, что захватить основные особенности распределения сенсорных сигналов, поступающих на каждом слое нейронной сети.

Головной мозг, нейронные сети и компьютеры

Этот раздел в данный момент активно редактирует участник Mvk608. |

Компьютерное моделирование архитектуры ветвления дендритов пирамидных нейронов [15]. Нейронные сети, используемые в области искусственного интеллекта, которые традиционно рассматриваются как упрощенные модели нейронной обработки в головном мозге, хотя связь между этой моделью и мозг биологической архитектуры обсуждается, так как не ясно, в какой степени искусственных нейронных сетей зеркало мозга. [16]

Предметом современных исследований в теоретической неврологии, является вопрос окружающей степени сложности и свойства, что отдельные нервные элементы должны воспроизвести нечто похожее животное интеллект.

Исторически сложилось, что компьютеры развились от архитектуры фон Неймана, которая основана на последовательной обработки и выполнения явного указания. С другой стороны, происхождение нейронных сетей на основе усилий по модели обработки информации в биологических системах, которые могут рассчитывать в основном на параллельную обработку, а также неявных инструкций на основе признания моделей «сенсорных» вход из внешних источников. Другими словами, в самом ее сердце нейронная сеть представляет собой сложную статистическую процессор (в отличие от того поручено последовательно обрабатывать и исполнять).

Нейронные кодирования озабочены тем, как сенсорные и другая информация представлена в мозге нейроны. Основная цель изучения нейронных кодирования для характеристики отношений между стимулом и индивидуальных или ансамбль нейронов ответы и взаимосвязь между электрической активностью нейронов в ансамбле. [17] Считается, что нейроны могут кодировать как цифровые, так и аналоговой информации [18].

Нейронные сети и искусственный интеллект

Нейронной сети (НС), в случае искусственных нейронов называется искусственных нейронных сетей (ИНС) или моделирование нейронных сетей (SNN), является взаимосвязанной группе естественных или искусственных нейронов, которые используются математические и вычислительные модели для обработки информации на основе connectionistic подход к вычислению. В большинстве случаев ИНС является адаптивная система, которая меняет свою структуру, основанную на внешней или внутренней информации, которая течет через сеть.

С практической точки зрения нейронные сети являются нелинейными статистического моделирования данных и принятия решений инструментов. Они могут быть использованы для моделирования сложных отношений между входами и выходами или найти закономерности в данных.

Тем не менее, парадигма нейронных сетей — то есть скрытые, не явные, обучения подчеркивается, — кажется, больше соответствуют своего рода природный ум, чем традиционный символ на основе искусственного интеллекта, который хотел бы подчеркнуть, наоборот, основанной на правилах обучения.

[Править] BackgroundAn искусственной нейронной сети включает в себя сеть из простых элементов обработки (искусственные нейроны), которые могут проявлять сложных глобальных поведения, определяются связи между элементами и обработки параметров элементов. Искусственные нейроны были впервые предложены в 1943 году Уоррен Маккалок, нейрофизиолог, и Уолтер Питтс, логик, который сначала сотрудничал в Чикагском университете [19].

Один классический тип искусственной нейронной сети Хопфилда периодически чистый.

В нейронной сети модель простых узлов (которые можно назвать целый ряд имен, в том числе «нейронов», «neurodes», «Обработка элементов» (ПЭ) и «единицы»), связанных вместе, чтобы сформировать сеть узлов — отсюда и термин «нейронных сетей». В то время как нейронные сети не должна быть адаптивной как таковой, ее практическое применение поставляется с алгоритмами, направленные на изменение силы (веса) соединений в сети для получения желаемого сигнала потока.

В современных реализациях программного обеспечения искусственных нейронных сетей подхода, основанного на биологии более или менее был оставлен на более практический подход, основанный на статистических данных и обработки сигналов. В некоторых из этих систем, нейронные сети, или части нейронных сетей (таких, как искусственные нейроны), которые используются в качестве компонентов больших систем, которые объединяют как адаптивные и не адаптивные элементы.

Концепция нейронной сети, кажется, впервые был предложен Аланом Тьюрингом в 1948 статье «Интеллектуальные машины».

[Править] Применение природных и искусственных нейронных утилита networksThe искусственных моделях нейронных сетей заключается в том, что они могут быть использованы для вывода функция из наблюдений, а также использовать его. Неконтролируемое нейронных сетей также может быть использован, чтобы узнать представлений вход, захватить основные характеристики входного распределения, см., например, машина Больцмана (1983), а в последнее время, глубокое изучение алгоритмов, которые могут неявно изучают функции распределения наблюдаемых данных. Обучение в нейронной сети особенно полезно в случаях, когда сложность данных или задачи делает создание таких функций руки нецелесообразно.

Задачи, которые искусственные нейронные сети применяются, как правило, подпадают под следующие категории:

Функция приближения и регрессионного анализа, в том числе прогнозирования временных рядов и моделирования. Классификация, в том числе картины и последовательность признания, новинка обнаружения и последовательного принятия решений. Обработка данных, в том числе фильтрации, кластеризации, слепой разделения сигналов и сжатия. Области применения включают ИНС системы идентификации и контроля (управления транспортным средством, управление технологическими процессами), игровые и принятия решений (нарды, шахматы, спортивные), распознавания (радиолокационных систем, лицо идентификации, распознавания объектов), последовательность признания (жесты, речь, рукописного распознавания текста), медицинская диагностика, финансовые приложения, интеллектуального анализа данных (или обнаружения знаний в базах данных «, KDD»), визуализации и по электронной почте спам.

Нейронные сети и нейронаука

Theoretical и вычислительной неврологии является полем связана с теоретического анализа и компьютерного моделирования биологических нейронных систем. Так как нейронные системы тесно связаны с когнитивными процессами и поведением, области тесно связаны с когнитивной и поведенческой модели.

Цель поле для создания моделей биологических нейронных систем, чтобы понять, каким образом биологические системы работают. Чтобы получить это понимание, нейрофизиологи стремиться сделать связь между наблюдаемыми биологическими процессами (данных), биологически обоснованных механизмов нейронной обработки и обучения (биологических моделях нейронных сетей) и теории (статистической теории обучения и теории информации).

Типы моделей

Many модели используются, определяется на различных уровнях абстракции и моделирования различных аспектов нервной системе. Они варьируются от модели краткосрочного поведение отдельных нейронов, через модели динамики нейронной схемы, связанные с взаимодействием между отдельными нейронами, в модели поведения, связанные с абстрактным нейронных модулей, которые представляют полный подсистем. К ним относятся модели долгосрочных и краткосрочных пластичность нервной системе и ее связи с обучением и памятью, от отдельных нейронов в системном уровне.

Современные исследования

это неиспользуемые раздел требует цитат для обеспечения возможности проверки.

Хотя первоначально исследования были обеспокоены главным образом с электрическими характеристиками нейронов, особенно важная часть расследования в последние годы изучение роли нейромодуляторов, таких как допамин, ацетилхолин и серотонин в отношении поведения и обучения.

Биофизические модели, такие как теория BCM, сыграли важную роль в понимании механизмов синаптической пластичности, и имел применения как в информатике и неврологии. Исследования продолжаются в понимании вычислительных алгоритмов, используемых в мозге, с недавних биологических доказательств для радиальных сетей основе и нейронные механизмы обратного распространения, как для обработки данных.

Вычислительного устройства были созданы в CMOS для биофизического моделирования и neuromorphic вычислений. Более поздние усилия перспективных для создания наноустройств [20] для очень больших масштабах основных компонентов анализа и свертки. В случае успеха эти усилия могли бы вступить в новую эру нейронных вычислений [21], что это шаг вперед цифровых вычислительных, так как оно зависит от обучения, а не программированием, а потому, что это принципиально аналоговые, а не цифровой, хотя первые экземпляры могут на самом деле быть с CMOS цифровых устройств.

Архитектура

Это неиспользуемые раздел требует цитат для обеспечения возможности проверки.

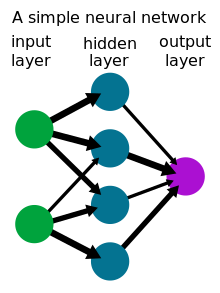

Базовая архитектура состоит из трех типов нейронов слоя: входной, скрытый и выходной. В прямой связью сети, прохождение сигнала от входа до выхода единицы, строго в прямой связью направлении. Обработка данных может растянуться на несколько слоев единиц, а не обратные связи присутствуют. Периодические сети содержат обратной связи. В отличие от прямой связью сети, динамические свойства сети очень важны. В некоторых случаях, активация значения единиц проходят процесс релаксации, что сеть будет развиваться в стабильное состояние, в котором эти активаций не менять больше.

В других приложениях, изменения активации значения выходных нейронов являются существенными, так, что динамическое поведение является выход в сеть. Другие архитектуры нейронной сети включают адаптивную теории резонанса карты и конкурентных сетей.

Критика

A общей критикой нейронных сетей, в частности, в робототехнике, в том, что они требуют большого разнообразия обучения для реальных операций. Это не удивительно, так как любая машина должна обучения достаточно примеров представителя для того, чтобы захватить основную структуру, которая позволяет обобщить новых случаев. Дин Pomerleau, в своих исследованиях, представленных в статье «Знания на основе обучения искусственных нейронных сетей для автономного вождения робот» использует нейронные сети для обучения робота автомобиль покататься на несколько типов дорог (одна полоса, многополосных, грязи и т. д.). Большое количество его исследование посвящено (1) экстраполяция несколько сценариев обучения от одного опыта обучения, и (2) сохранение прошлого разнообразия обучения, с тем, что система не станет перетренированности (если, например, представлена серией правого поворотов — она не должна научиться всегда повернуть направо). Эти проблемы являются общими в нейронных сетях, которые должны решить из числа самых разнообразных ответов, но могут быть решены несколькими способами, например, случайно сдачи обучающих примеров, используя численный алгоритм оптимизации, который не слишком большие шаги, когда изменение сетевых соединений после, например, или, группируя примеров так называемых мини-партиями.

АК Дьюдни, бывший обозреватель журнала Scientific American, писал в 1997 году: «Хотя нейронных сетей делают решить несколько проблем, игрушки, свои полномочия вычислений настолько ограниченным, что я удивлен, никто принимает их всерьез в качестве общего решения проблем, инструмент». (Дьюдни, стр. 82.)

Аргументы в пользу позиции Дьюдни в том, что для реализации крупных и эффективных программных нейронных сетей, много ресурсов, переработки и хранения должны быть зафиксированы. В то время как мозг аппаратных учетом задач обработки сигналов с помощью графика нейронов, имитируя даже наиболее упрощенной форме на фон Неймана технология может заставить конструктор Н. Н. заполнить многие миллионы строк базы данных для соединения — который может потреблять огромное количество памяти компьютера и на жестком диске. Кроме того, конструктор Н. Н. систем часто приходится имитировать передачу сигналов по многим из этих соединений и связанные с ними нейроны, — которые должны часто сочетается с невероятным количеством процессоров вычислительной мощности и времени. В то время как нейронные сети часто приводят к эффективным программам, они тоже часто делают это за счет эффективности (они, как правило, потребляют значительное количество времени и денег).

Аргументы против позиции Дьюдни в том, что нейронные сети были успешно использованы для решения многих сложных и разнообразных задач, начиная с автономно летающих самолетов [2] для обнаружения мошенничества кредитной карты [3].

Технология писатель Роджер Бриджмена прокомментировал заявления Дьюдни о нейронных сетей:

Нейронные сети, например, находятся на скамье подсудимых не только потому, что они были раздутыми до небес, (что не имеет?), Но и потому, что вы можете создать успешную сеть без понимания того, как она работает: кучу цифр, которая захватывает его поведение, по всей вероятности быть «непрозрачным, нечитаемые таблицы … бесполезны в качестве научного ресурса». Несмотря на решительное заявление, что наука является не технология, Дьюдни кажется здесь, чтобы пригвоздить к позорному столбу нейронных сетей, как плохой наукой, когда большинство из тех, размышления, они просто пытаются быть хорошими инженерами. Нечитаемые таблицы, полезная машина могла читать все еще будет хорошо стоит иметь. [22]

В ответ на такую критику, следует отметить, что хотя это правда, что анализ, что было изучено с помощью искусственной нейронной сети трудно, гораздо легче сделать, чем анализировать то, что узнал от биологической нейронной сети. Кроме того, исследователей, принимавших участие в исследовании алгоритмов обучения нейронных сетей постепенно раскрытии общих принципов, которые позволяют обучения машины, чтобы быть успешным. Например, Bengio и LeCun (2007) написал статью о местном против нелокальной обучения, а также мелкой против глубоких архитектура [4].

Некоторые другие критики пришли от верующих гибридных моделей (сочетание нейронных сетей и символический подходы). Они выступают за смешивать эти два подхода и считаем, что гибридные модели могут лучше отразить механизмы человеческого разума (Солнце и Bookman 1990).

См. также

- Искусственная нейронная сеть

- Нейронная сеть Ворда

- Нейронная сеть Кохонена

- Нейронная сеть Хопфилда

- Нейронная сеть Коско

- Нейронная сеть Джордана

- Нейронная сеть Элмана

Примечания

- ↑ 1 2 Bain. Mind and Body: The Theories of Their Relation. — New York : D. Appleton and Company, 1873.

- ↑ 1 2 James. The Principles of Psychology. — New York : H. Holt and Company, 1890.

- ↑ Sherrington, C.S. "Experiments in Examination of the Peripheral Distribution of the Fibers of the Posterior Roots of Some Spinal Nerves". Proceedings of the Royal Society of London. 190: 45—186.

- ↑ McCullock, Warren (1943). "A Logical Calculus of Ideas Immanent in Nervous Activity". Bulletin of Mathematical Biophysics. 5 (4): 115—133. doi:10.1007/BF02478259.

{{cite journal}}: Неизвестный параметр|coauthors=игнорируется (|author=предлагается) (справка) - ↑ Farley, B (1954). "Simulation of Self-Organizing Systems by Digital Computer". IRE Transactions on Information Theory. 4 (4): 76—84. doi:10.1109/TIT.1954.1057468.

{{cite journal}}: Неизвестный параметр|coauthors=игнорируется (|author=предлагается) (справка) - ↑ Rochester, N. (1956). "Tests on a cell assembly theory of the action of the brain, using a large digital computer". IRE Transactions on Information Theory. 2 (3): 80—93. doi:10.1109/TIT.1956.1056810.

{{cite journal}}: Неизвестный параметр|coauthors=игнорируется (|author=предлагается) (справка)